Belgische AI-pionier Pieter Abbeel: ‘Er moeten regels komen voor AI, bij voorkeur opgelegd door de overheid’

Honderden experts waarschuwden kort geleden dat AI op termijn de mensheid kan uitroeien. De Belgische AI-hoogleraar Pieter Abbeel ziet de apocalyps nog niet meteen aan de horizon opdoemen. ‘Er zijn gevaren aan AI verbonden, maar die zijn niet onbeheersbaar.’

‘Jullie hebben allemaal ChatGPT gebruikt”, zei een professor onlangs tegen zijn studenten nadat hij hun eindwerk had beoordeeld, “en dat terwijl jullie wisten dat dit niet mocht. Ik kan dus niet anders dan jullie een onvoldoende geven.” De studenten ontkenden ten stelligste en vroegen op basis waarvan hij dat dacht. “Omdat ik het ChatGPT gevraagd heb”, antwoordde de professor, “en het programma bevestigde het.”

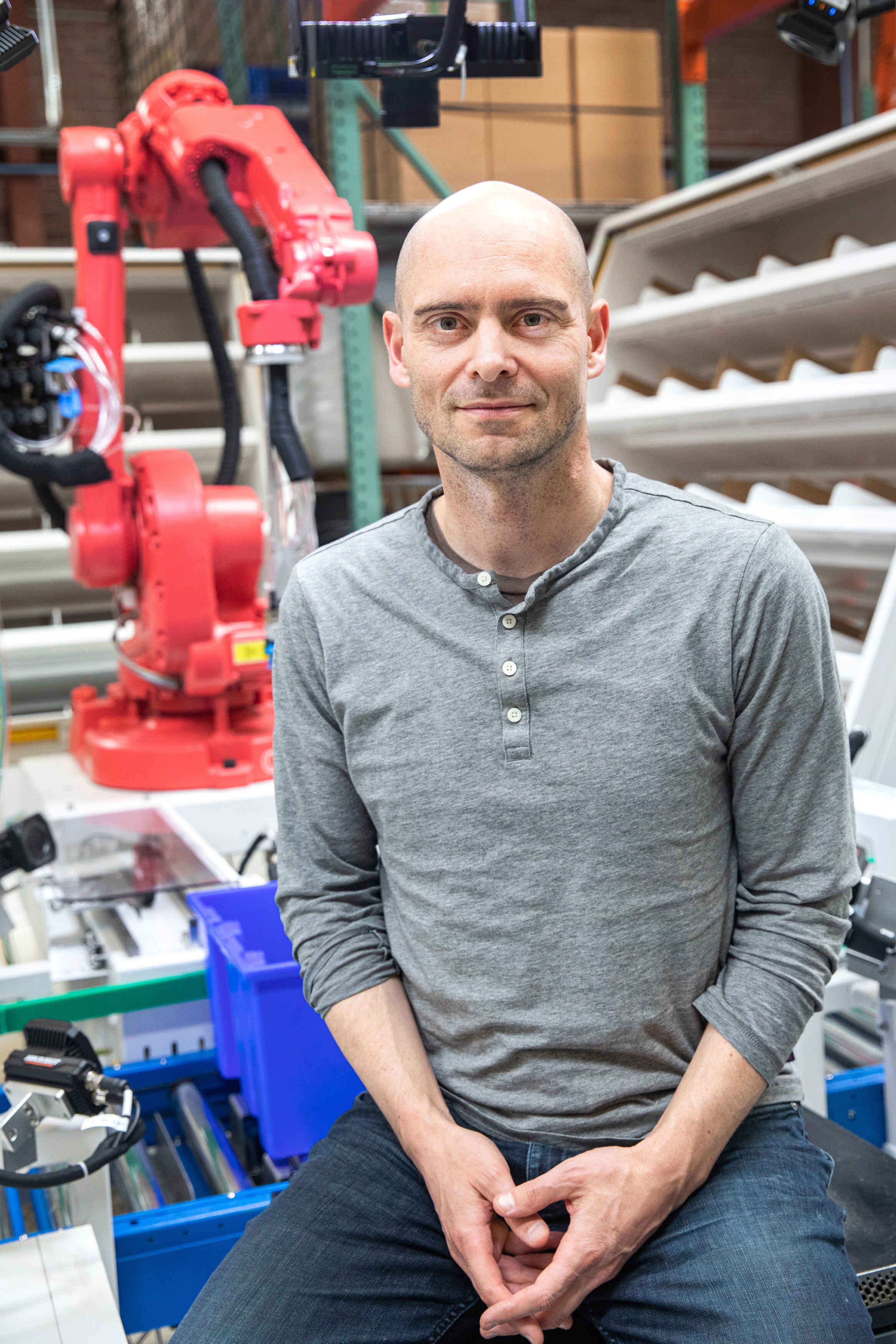

Het zou een grap kunnen zijn, maar het is echt gebeurd, zegt Pieter Abbeel, de Vlaamse AI-specialist die het voorbije decennium een topcarrière uitbouwde in de VS. Hij meent dat er nogal wat misverstanden bestaan over zijn vakgebied, meestal gebaseerd op onvolledige of zelfs ronduit foute informatie, waardoor de verwachtingen soms te hooggespannen zijn, of er angst ontstaat.

Geen geschiktere man dus om die misverstanden de wereld uit te helpen dan Abbeel zelf, die op zijn 45ste over een cv beschikt waar menig Silicon Valley-hotemetoot alleen maar van kan dromen. Na zijn studie aan de KU Leuven doctoreerde hij in artificiële intelligentie aan de Californische Stanford University. Sindsdien leidt hij aan Berkeley University het Robot Learning Lab. Net zoveel voldoening put hij uit het delen van zijn kennis, met zijn studenten natuurlijk, maar ook met het grote publiek via zijn podcast The Robot Brains.

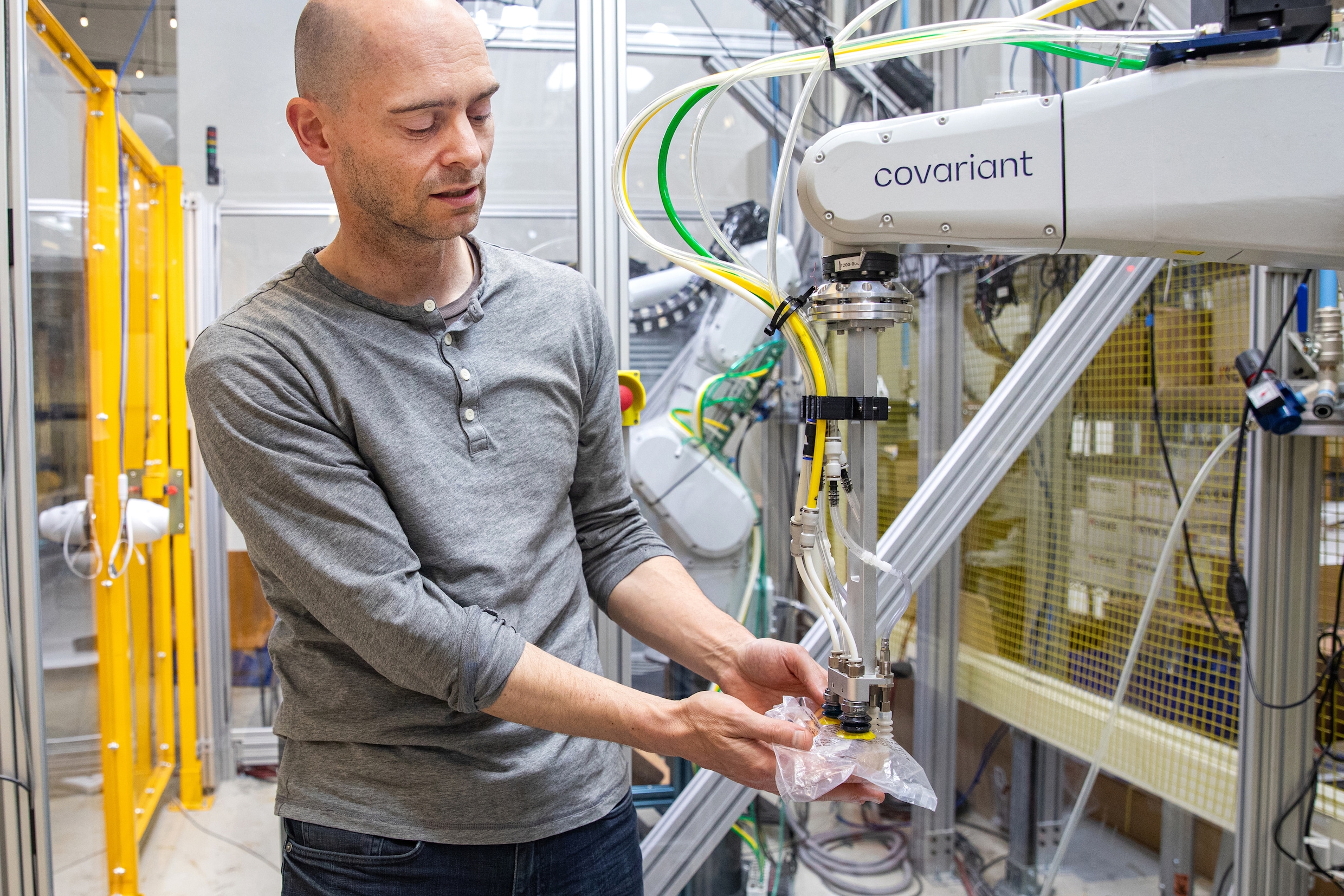

Bijna tien jaar geleden zette Abbeel zijn eerste stapjes in de bedrijfswereld. Met een aantal studenten startte hij Gradescope, dat AI-tools ontwikkelt waarmee docenten de werkstukken van studenten kunnen beoordelen. Een andere student richtte daarna OpenAI op, het bedrijf achter ChatGPT, waar Abbeel ook een jaar aan meewerkte. Vervolgens hield hij – alweer met enkele studenten – Covariant boven de doopvont, dat robots ontwikkelt die voor een mens afstompende maar voor een robot aartsmoeilijke taken uitvoeren, zoals in een magazijn bjecten verzamelen en ze in een kartonnen doos steken.

“Robots die steeds dezelfde taak uitvoeren bestaan al lang, autofabrieken staan er vol mee”, vertelt Abbeel hierover. “Maar robots die iedere keer iets anders moeten vastpakken, het ene groot en hoekig, het andere klein en bolvormig bijvoorbeeld, zijn veel moeilijker te maken. Je robot moet immers het object dat hij wil oppakken kunnen zien en zijn strategie aanpassen. Met AI lukt dat.”

Abbeel richtte ook een durffonds op, AIX Ventures, dat aankomende AI-ondernemers met raad en daad bijstaat. “Dat geeft veel voldoening”, zegt Abbeel, “want met een telefoontje van een paar uur kan ik iemand op basis van mijn ervaring echt vooruithelpen.”

Een bezig baasje dus, Pieter Abbeel, die niet zomaar een gaatje in zijn agenda vindt om een interviewafspraak te verplaatsen. De kinderoppas die tijdens ons gesprek op zijn baby zou passen heeft het immers laten afweten, waardoor hij zelf voor de uk dient te zorgen. Maar geen paniek: we maken er een wandelinterview van, waarbij de baby heerlijk doezelt in het draagharnas op de buik van zijn vader.

“De mens is een wonderlijk wezen”, verklaart Abbeel tijdens de wandeling zijn levenslange fascinatie voor AI, “dat creatief uit de hoek kan komen en voor vrijwel ieder probleem wel een oplossing weet te verzinnen. Misschien kan een machine ons daarbij helpen, was mijn initiële uitgangspunt. En dat is het nog steeds, want in mijn onderzoek richt ik me vooral op het verschil tussen menselijke intelligentie en onze huidige AI-systemen. Wat ontbreekt er nog? En wat kan AI niet wat mensen wel kunnen?

“Vandaag heeft ChatGTP het hele internet nodig om een vraag te beantwoorden, terwijl een 3-jarige veel begrijpt over de wereld zonder dat internet te kennen. Fouten die AI maakt, weet die peuter te omzeilen. Hoezeer we dus ook onder de indruk mogen zijn van onze huidige AI, onfeilbaar is die zeker niet.”

AI was heel lang een belofte, zoiets als kernfusie. Een halve eeuw geleden had men het er al over, maar er kwam niets van, tot het een jaar geleden met ChatGPT opeens realiteit bleek. Vanwaar die plotse doorbraak?

“Het begon allemaal in 1956, toen computerwetenschapper John McCarthy de term artificial intelligence voor het eerst gebruikte. Tot 2012 bleef het aanmodderen in de marge. Er waren wel ideeën, maar veel vooruitgang werd er niet geboekt. Schaakcomputer Deep Blue versloeg in 1997 weliswaar wereldkampioen Garri Kasparov, maar veel verder dan dat ging het niet.

“In 2012 gebeurde er echter iets fundamenteel anders, iets waar het grote publiek pas tien jaar later over hoorde, toen ChatGPT zijn opwachting maakte. Er werd een grote beeldherkenningswedstrijd georganiseerd. Geoffrey Hinton, die onlangs Google verliet om te waarschuwen voor de gevaren van AI, werkte toen aan de universiteit van Toronto. Hij toonde dat neurale netwerken veel beter geschikt waren voor beeldherkenning dan enige andere techniek die men al had geprobeerd. En je kon neurale netwerken ook gebruiken voor taal, of voor een combinatie van taal en beeld.

“Dat Hinton dat inzag, had trouwens veel te maken met de ontwikkeling van de computerhardware. Voor het opzetten van een neuraal netwerk heb je immers veel computerkracht nodig. In 2012 beschikten we pas over computers die dat aankonden. Van 2012 tot 2020 werden neurale netwerken getraind om met verschillende soorten data om te gaan, zoals spraakherkenning, computervertaling en videogames.

“De volgende grote stap werd in 2020 gezet. Toen toonde OpenAI dat je geen aparte neurale netwerken gericht op het uitvoeren van verschillende taken moest ontwerpen, maar wel een groot neuraal netwerk waar je alle mogelijke informatie in kwijt kon, waarna dat in staat zou zijn om al die verschillende taken uit te voeren. Dat is het GPT-model, dat het hele internet gebruikt en daardoor over meer informatie beschikt dan een mens.”

BIO

geboren in Antwerpen in 1977 • studeerde burgerlijk ingenieur electronica aan de KU Leuven; doctoreerde in de AI aan Stanford • leidt het Robot Learning Lab aan Berkeley, waar hij hoogleraar is • richtte AI-bedrijfjes Gradescope en Covariant op; stond mee aan de wieg van OpenAI; co-oprichter van het durffonds AIX Ventures • praat voor zijn podcast The Robot Brains met grote namen uit de AI-wereld

Wat opvalt aan de AI-wereld, en ook aan uw carrière trouwens, is het samengaan van de academische en de bedrijfswereld. Hoe belangrijk is privé-initiatief voor de ontwikkeling van AI?

“De academische wereld werkt vaak op een fundamenteler niveau, waar de economische winst van wat je onderzoekt nog niet duidelijk is en waar privébedrijven dus liever van wegblijven. De grote doorbraak van 2012 kwam er aan de universiteit van Toronto en was dus academisch. Dat bleef nog vele jaren zo, tot geld steeds belangrijker werd voor dit onderzoek. Ik denk dat er in de AI-wereld fundamenteel geen verschil is in dynamiek tussen academie en bedrijfswereld. Het grote verschil is dat bedrijven over budgetten beschikken waar universiteiten alleen maar van kunnen dromen.

“Computerkracht kost nu eenmaal handenvol geld. Als je het volgende GPT-model op poten wilt zetten, heb je 100 miljoen dollar nodig. Geen enkele professor krijgt dat bij elkaar om een experiment uit te voeren. Die heeft over het algemeen een budget van ongeveer 1 miljoen per jaar. Het draait dus allemaal om geld. Geef mij en mijn team aan Berkeley het budget waar OpenAI over beschikt, en ik ben er zeker van dat we nog beter werk verrichten.”

Is dat geen bedenkelijke situatie? Privéfirma’s hebben toch andere belangen en doelen dan universiteiten?

“Ongetwijfeld, maar die firma’s worden wel door mensen geleid. Ik heb in 2016 voor OpenAI gewerkt, dus ik weet wat voor mensen dat zijn. Zij hebben echt geen slechte bedoelingen en willen de wereld alleen vooruithelpen. Kan iets wat ze ontwikkelen door anderen misbruikt worden? Dat is vanzelfsprekend altijd een zorg. Bovendien heeft ieder bedrijf af te rekenen met de druk van de investeerders die de winst willen maximaliseren. Als je niet de kapitaalkrachtigste investeerders aan je weet te binden, mag je je droom om het beste AI-bedrijf te worden opbergen. Vandaag maakt OpenAI het mooie weer, maar laat morgen iemand met een paar honderd miljard dollar zwaaien en dat kan snel veranderen.”

Worden de mogelijkheden van AI niet wat overdreven? Met ChatGPT converseren is plezierig, maar waar zit de echte meerwaarde?

“Dat is inderdaad de cruciale kwestie. Drie vragen duiken daarbij op. Hoe nieuw is AI in vergelijking met wat er vroeger was? Wat levert het ons vandaag op? En wat mogen we er in de toekomst van verwachten? Het is vooral omwille van het laatste dat mensen zo enthousiast zijn.

“Hoe nieuw is het? De beslissing van OpenAI om een neuraal netwerk met het hele internet te voeden was revolutionair. Dat gebeurde via woordvoorspelling. Je AI krijgt een bepaald woord en moet voorspellen welk woord erop volgt. OpenAI trainde zijn AI om daar heel goed in te worden, waardoor die overtuigend menselijk werd. Je kunt ermee discussiëren en het kan volledige zinnen gebruiken. ChatGPT voegde daar nog iets aan toe, AI discussies laten voeren met echte mensen en die discussies beoordelen. Hoe meer voldoening ze schenken, hoe hoger ze gewaardeerd worden. Je AI leert dus niet alleen hoe het ene na het andere woord komt op het internet, maar ook hoe dat gebeurt in goede discussies met echte mensen.

“ChatGPT is daardoor heel goed in het schrijven van teksten over om het even welk onderwerp. Stel je voor dat je je AI alle medische artikels voedt die ooit geschreven zijn. Als je het systeem dan een vraag stelt over een bepaalde persoon met bepaalde symptomen en uitslagen van bloedonderzoeken en dergelijke, zal die AI meer weten dan om het even welke arts. Die kan al die kennis immers nooit verwerven. Dat is toch een fantastisch vooruitzicht?”

Maar is het intelligentie? Veel meer dan uit bestaande data een conclusie trekken is het toch niet?

“ChatGPT, de performatiefste AI van het moment, voegt inderdaad niets toe aan de informatie die het heeft. Het genereert geen nieuwe kennis. Stel dat je een medicijn wilt testen, dan zal het je geen nieuwe test kunnen geven. Het zal alleen kunnen kiezen uit de opties die in zijn geheugen zitten. Een mens zal dat wel kunnen. In die zin heb je gelijk en staat de menselijke intelligentie nog altijd een trede hoger. Maar dat kan veranderen.

“In 2016 versloeg AlphaGo een professionele Go-wereldkampioen. Het systeem speelde wedstrijden op een manier die niemand verwachtte. In dergelijke mate dat de makers van het programma aanvankelijk niet eens doorhadden hoe geniaal bepaalde zetten wel waren. Ze dachten dat AlphaGo fouten maakte. Het principe achter het programma was dat het de wiskunde achter alle bestaande wedstrijden uit het verleden gevoerd kreeg en nadien tegen zichzelf begon te spelen, waarbij het een steeds hoger niveau bereikte. Het leerde dus van zichzelf.

“Voor een Go-programma is dat makkelijk. Je zit in een kleine, afgeschermde omgeving met eenvoudige regels en het gaat alleen over winnen of verliezen. Dit op het hele internet toepassen, is natuurlijk een ander paar mouwen. Dat is trouwens precies mijn onderzoeksveld, reinforcement learning: AI ontwikkelen die bijleert door zelf zaken te doorgronden.”

Stel dat dit lukt, moeten we dan bang zijn? Heeft Geoffrey Hinton gelijk als hij de wereld waarschuwt voor AI?

“We moeten beseffen dat er gevaren zitten aan AI, maar dat betekent niet dat die gevaren onbeheersbaar zijn. Over vijf jaar zal de AI van vandaag voorbijgestreefd zijn. We moeten daarom vandaag al nadenken over de wijze waarop bepaalde mensen die toekomstige systemen zullen gebruiken, misbruiken of door onwetendheid verkeerd gebruiken.

“We mogen AI zijn gang niet laten gaan. Er moeten regels komen die bepalen wat kan en wat niet kan, bij voorkeur opgelegd door de overheid, aangezien er ook controle moet komen op de handhaving van die regels. Het is immers niet omdat er een wet bestaat die zegt dat je iemands handtekening niet mag vervalsen dat sommige mensen dit niet zullen doen, maar wel omdat ze vrezen gestraft te zullen worden als ze het doen.”

U bent dus een voorstander van de EU-wetgeving op dit vlak?

“Niet iedere wetgeving is goed, het gaat altijd over de details. Maar ik sta wel achter het principe dat ze er moet zijn.”

U vreest niet dat zo’n wetgeving de ontwikkeling van AI zal vertragen?

“Dat er een verplichting komt om te vermelden dat bepaalde beelden of teksten met AI gemaakt zijn, vind ik een goede zaak die de verdere ontwikkeling niet in de weg zal staan. Maar ingrijpen in wat wel en niet kan, gaat misschien te ver.

“Als AI het makkelijk maakt voor scammers om de identiteit van een ander aan te nemen en zo mensen op te lichten, omdat ze denken met hun moeder of dochter te maken te hebben, heb je simpelweg met een misdaad te maken. Dat heeft in feite niets met AI te maken. Daar moeten geen nieuwe wetten of regels voor komen. Die zijn er al.”

Maar wat doe je dan met het verhaal over de man die zelfmoord pleegde nadat hij zes weken lang iedere ochtend en avond met een chatbot had zitten praten?

“Een jammere zaak die vermeden had kunnen worden, natuurlijk. Maar we mogen niet vergeten dat het een ongewilde consequentie van het gebruik van de chatbot was. Die was niet gemaakt met het doel mensen de dood in te drijven. Ik denk dat we dit onderscheid duidelijk moeten maken. Hoe voorkom je zoiets, is dan de vraag. Daar moeten AI-ontwikkelaars meer over nadenken.

“In de VS heeft de overheid de grootste AI-spelers bij elkaar gebracht, zoals OpenAI en Google, om hen te overtuigen externe audits te laten uitvoeren op hun producten om dergelijke ongewenste consequenties in de toekomst te vermijden. Ook dit initiatief staat nog in de kinderschoenen, maar het heeft potentieel.”

Kun je AI geen ethische regels aanleren, zodat het zichzelf controleert?

“Dat heet AI alignment: AI die zich conformeert aan menselijke, ethische principes. Daar wordt al volop aan gewerkt, en wel op basis van twee verschillende modellen. OpenAI baseert zich daarbij op zijn bestaande model om AI kennis bij te brengen, door in dialoog te gaan en die positief of negatief te beoordelen. Zo kun je je AI aanleren wat mensen leuk vinden en wat daarentegen niet door de beugel kan.

“Googles Anthropic werkt anders. Het idee is daar dat er een soort ‘grondwet’ moet komen, met duidelijke regels die AI moet volgen. Het lijkt me niet eenvoudig om op die manier alle nuances te vatten, al zijn sommige principes wel makkelijk bij te brengen, zoals dat AI niet tot iemands dood mag leiden. Dat is vrij zwart-wit. Maar als er subtiele keuzes moeten gemaakt worden, wordt het veel complexer.”

In een recent essay, Vita contemplativa, merkt de Duits-Koreaanse filosoof Byung-Chul Han op dat het grote verschil tussen een mens en AI is dat die eerste zich verveelt, lanterfant en zijn geest de vrije loop laat, waardoor er serendipiteit en creativiteit ontstaan, terwijl AI gewoon rechtstreeks op zijn doel afgaat en een antwoord zoekt op de vraag die het voorgelegd krijgt. Juist?

“Natuurlijk heeft hij daar een punt, maar je mag niet verwachten dat we van de ene op de andere dag een volmaakte AI ontwikkelen. Dat vraagt tijd. Stel dat iemand tien jaar geleden had beweerd dat we vandaag een AI zouden hebben die alles kan wat de onze kan, dan zou iedereen die persoon gek hebben verklaard. Als je die iemand gevraagd had wat ‘echte’ AI zou moeten kunnen, had hij wellicht twintig zaken opgesomd waarvan we er vandaag vijftien hebben kunnen afvinken.

“Het is dus goed dat filosofen nadenken over AI en ons uitdagen om ambitieus te blijven, want het is zo dat vooruitgang werkt, maar het is ook goed om ons te realiseren dat als je vandaag zo’n lijst zou maken we die in de komende vijf jaar alweer zouden kunnen halveren. We gaan echt wel met rasse schreden vooruit.”

De toekomstige AI zou er dus weleens helemaal anders uit kunnen zien dan de huidige?

“Vanzelfsprekend. Onze AI weet veel, maar maakt ook domme fouten. Waarom dat gebeurt, weten we eigenlijk niet. Maar dat houdt ons niet tegen om te dromen van een robuustere en feillozere AI.

“Het grote verschil tussen menselijke intelligentie en AI lijkt me voort te vloeien uit het feit dat mensen leren door te interageren met de wereld en AI alleen informatie gevoerd krijgt en die passief absorbeert. Mensen horen, zien, ruiken, proeven en voelen: allemaal zaken die AI niet kan. Een AI is beperkt tot kennis. In een lichaam zitten maakt het ons makkelijker om de wereld te begrijpen.

“Mensen onderzoeken, experimenteren en proberen nieuwe zaken uit. De baby op mijn buik doet dat al. Hij is een miniatuurwetenschapper. Dat kun je van een GPT-model absoluut niet zeggen.”

Wat is dan uw grote droom?

“Op korte termijn: de logistiek die gepaard gaat met het beschikbaar maken van fysieke objecten toegankelijker maken. Digitale content is via het internet universeel downloadbaar. Wil je een film bekijken, dan betaal je een streamingdienst en je kijkt. Voor de fysieke wereld geldt dat nog lang niet. Met Covariant droom ik ervan de juiste automatisering in te voeren om de fysieke wereld stukken bereikbaarder en goedkoper te maken.

“Op langere termijn droom ik van het creëren van een health space. Er zijn nog veel ziekten die we niet begrijpen en waar we geen geneesmiddelen voor hebben. Hier is een belangrijke rol weggelegd voor AI. Het zou experimenten en datareeksen kunnen analyseren en suggesties kunnen bieden over welke experimenten meer kans op slagen hebben dan andere. AI kan hier iets doen waar mensen niet zo goed in zijn, of waar ze veel meer tijd voor nodig hebben. Voor AI maakt het immers niet uit wat het te lezen krijgt – DNA-reeksen of woordreeksen – terwijl dat voor een mens wel echt anders is.”

We moeten AI dus gebruiken voor datgene waarin het uitblinkt, en niet voor iets waarin wij mensen beter zijn? DNA-reeksen analyseren, geen romans schrijven?

“Ik zou het wellicht iets anders uitdrukken, maar daar komt het wel op neer. Laat mensen doen waar ze goed in zijn en AI waar AI goed in is. AI moet geen taken uitvoeren die mensen beter kunnen. Laat het dingen doen waar wij het lastig mee hebben. En dat verandert constant. Het neuraal netwerk in ons hoofd stelt ons in staat om met een auto te rijden. In principe zou het neuraal netwerk in een computer dat dus ook moeten kunnen. Vandaag lukt dat nog niet, maar de dag dat het wel lukt komt steeds dichterbij.”

Lees ook

Geselecteerd door de redactie